Si le pides a una IA que encuentre una conexión entre dos datos, la encontrará. Aunque sea una coincidencia estadística absurda.

La IA está programada para complacerte, no necesariamente para ser rigurosa. Hoy es común subir una base de datos y pedirle: «Analiza esto y dime por qué bajaron las ventas».

El modelo procesará los números y te dará una respuesta convincente: «Las ventas bajaron porque los días lluviosos aumentaron un 15% y eso redujo el tráfico peatonal».

Suena lógico. Suena inteligente. Pero podría ser totalmente falso.

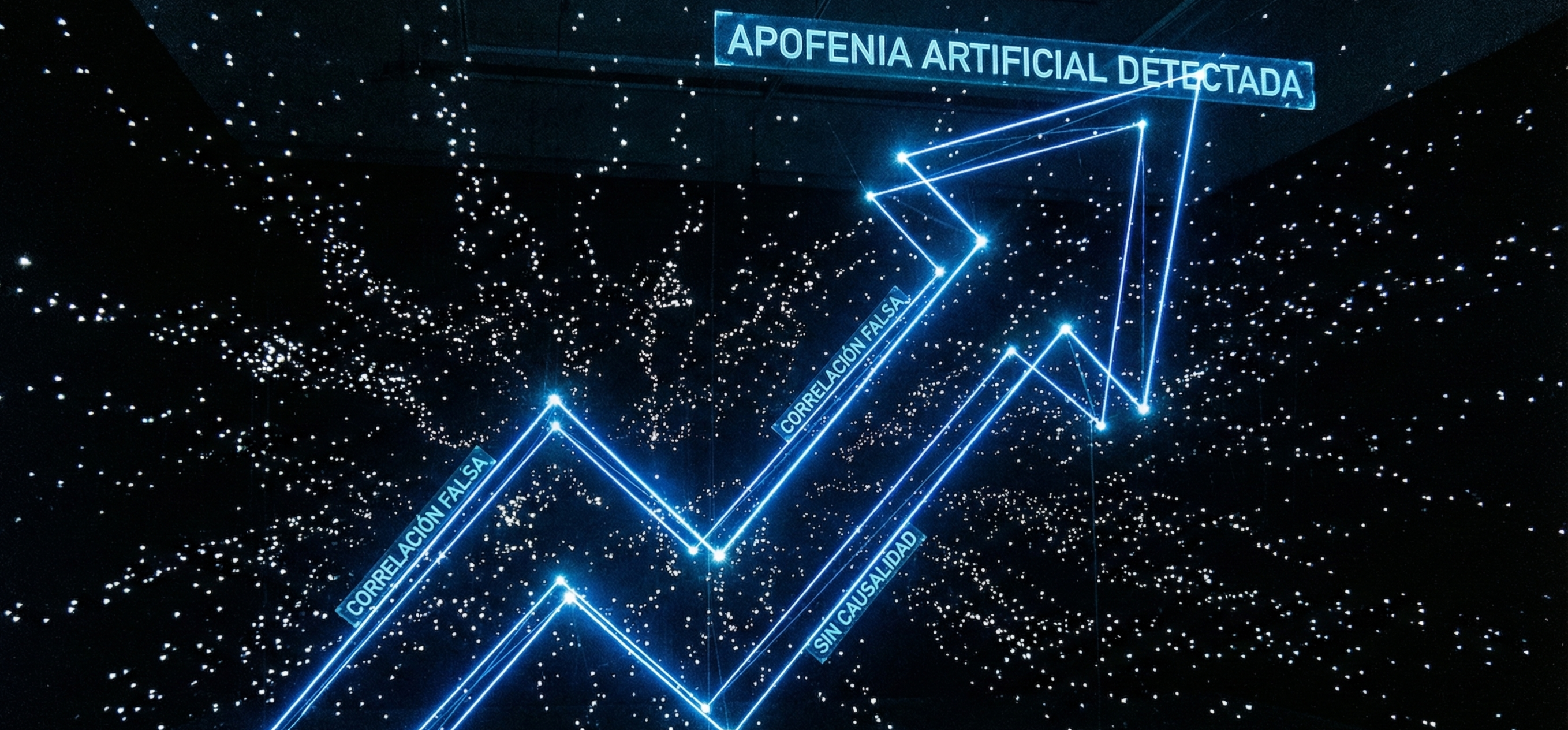

Esto se llama Apofenia de Datos.

La IA es una máquina de predicción de patrones. No entiende de Causalidad (A causa B), solo entiende de Correlación (A y B ocurrieron juntos).

El riesgo para 2026 no es que la IA no sepa analizar datos. El riesgo es que la IA «fuerce» narrativas lógicas sobre datos aleatorios para cumplir con tu instrucción.

Aquí es donde el rol del Analista Humano se vuelve insustituible:

✅ El rol del Escéptico. La IA genera la hipótesis («Llovió y bajaron las ventas»). El humano valida la causalidad («No, bajaron porque se cayó el servidor de checkout, la lluvia fue coincidencia»).

✅ El peligro del Sesgo de Confirmación. Si interrogas a los datos buscando una respuesta específica, la IA te la dará. Un buen analista sabe hacer las preguntas neutras para no viciar el resultado.

Mi consejo: Usa la IA para detectar anomalías y procesar volumen, pero nunca delegues el juicio de causalidad.

Un gráfico bonito generado por una red neuronal no deja de ser una mentira si la matemática detrás es una alucinación estadística. En Marketing, confundir «casualidad» con «causalidad» cuesta millones de pesos.

Comments are closed.